Vad innebär utvecklingen inom AI för kommunikatörer? Hur används verktygen i dag, och hur kan de komma att användas i framtiden? Och hur kan vi som samhälle implementera AI på ett sätt som hjälper snarare än stjälper? Detta och mycket mer diskuterades under Forum för forskningskommunikation 2023 den 28 november i Stockholm. Se konferensen i efterhand via filmerna nedan (vill du se filmerna textade aktiverar du undertexter i mediaspelaren, under symbolen CC).

Drygt 200 deltagare hade samlats i Stockholm och ytterligare 280 personer deltog online när Forum för Forskningskommunikation djupdök i AI och den snabba tekniska utveckling som skett de senaste åren. Under dagen diskuterades AI-utvecklingen både utifrån vad den innebär för yrkesverksamma forskningskommunikatörer och hur den kan komma att påverka samhället i stort.

Ett återkommande budskap var å ena sidan uppmaningen till publiken att våga pröva den nya tekniken och vara öppna för dess möjligheter, och å andra sidan betonandet av tydligare riktlinjer och regelverk för säker och etisk implementering av AI. Under dagen fick deltagarna dessutom en hands-on workshop kring hur man kan använda program för att inhämta kunskap, effektivisera arbetsflöden och producera text och rörligt innehåll.

Anna Maria Fleetwood, senior rådgivare på Vetenskapsrådet, inledde med att hälsa välkomna till Forum för Forskningskommunikation, som arrangeras för elfte året i rad. Dagen leddes av moderator Anna Dyhre, och hennes assistent AIna.

AI i dag och imorgon

Dagens första talare, Fredrik Carlsson, algoritmforskare vid RISE, Reserach Institutes of Sweden, gav en kort återblick över AI:s utveckling och nära framtid. Inom området bildgenerering har utvecklingen gått från skickliga bilder med ibland kusliga felaktigheter (vem minns inte de fyrfingrade händerna på i övrigt fotorealistiska bilder, frågade Fredrik), till att snart kunna producera verklighetstrogen rörlig bild utifrån textbeskrivningar.

De stora språkmodellernas utveckling har gått från att kunna göra fortsättningar på textpromptar till att kunna gå i dialog med användaren och kontinuerligt anpassa text. Vi är nu på väg in i det ”tredje paradigmet” av AI, avslutade Fredrik, den tid då AI integreras i alla de digitala verktyg vi redan använder.

Hanifeh Khayyeri, avdelningschef i datavetenskap och också hon vid RISE, lyfte i sin presentation fram ett par stora och övergripande riskområden med AI-utvecklingen. Ett av dessa är desinformation. Hon klargjorde att det i dag inte finns något säkert sätt att avgöra om en bild är producerad av AI eller inte – även om manipulation av bilder går att spåra. För bildkonsumenten blir det därför allt viktigare att hitta trovärdiga källor som har originalbilder, påpekade hon.

Medborgarskydd och integritet är enligt Khayyeri det andra centrala riskområdet. Sverige är framstående inom digitalisering men inte särskilt långt fram när det gäller cybersäkerhet, var hennes budskap. Problemen med bias och diskriminering med AI-teknik blir ständigt tydligare, menade hon, och betydelsen av att skapa och implementera rättvisa och transparent system är därför överhängande.

Trots de överskuggande problemen uppmanade Khayyeri publiken att pröva AI-verktyg, inom de områden och roller den känner väl.

– Att AI-utvecklingen innebär en hel del utmaningar kan nog många skriva under på, men den medför också nya möjligheter inom en rad olika områden. Våga testa verktygen i er verksamhet – det är så ni hittar styrkor, svagheter och rätt användningsområden, menade hon.

Olle Zachrison, AI-ansvarig på Sveriges Radio, illustrerade därefter hur Sveriges Radio använder AI idag, till exempel genom tips om ”liknande lyssning”. Han lyfte också synpunkten att en viss ’robotlik’ kvalitet i AI-producerade tjänster kan bra för transparensen.

Zachrison argumenterade för snabbhet inom det offentligas användning av AI-stöd och tog exemplet automatisk textning för döva och hörselnedsatta. Trots risken att programmen gör fel, är textning av ljud är en viktig tillgänglighetsfråga och värdet av att snabbt kunna få ut textat material överväger. ”Det är bättre att det blir lite fel och SR är tydliga med det, än att det inte görs”, sa Zachrison.

Hanifeh Khayyeri och Olle Zachrison möttes efter det i ett panelsamtal.

Delad syn på AI

Under rubriken AI & jag gav Vetenskap och Allmänhets utredare Lina Rådmark en förhandstitt på resultaten från VA-barometern, den årliga attitydundersökning som i år utöver frågor om förtroende och intresse för forskning och forskare också undersökt allmänhetens syn på AI. Resultaten visar, sade Rådmark, att allmänheten har en försiktig och avvaktande hållning till utvecklingen – och tydligt mer negativt än 2019 då barometern ställde frågan för första gången. Avsevärt fler har också en uppfattning om AI.

En av de troliga anledningarna till förändringen, menade Rådmark, är att AI nu blivit mer tillgängligt, genomsyrar stora delar av samhället och är en del av människors vardag.

Lucella Bergström, samordnare digitala Fryshuset, presenterade ungas attityder till AI genom resultat från studien Unga om AI och metaverse som genomförts tillsammans med teknikföretaget Samsung. Studien har frågat unga i Sverige, Norge, Danmark och Finland.

Inställningen till AI är bland unga mer positiv än negativ – och mer positiv än bland befolkningen som helhet, som en jämförelse med VA-barometern visar. Unga är också mer osäkra på utvecklingen än det svenska genomsnittet, påpekade Bergström.

På frågan om unga tror att AI kan hjälpa dem att lära sig var en majoritet övertygade om detta. Däremot tyckte flertalet unga – strax över 40 procent – att de inte fick den kunskap de behövde från skolan om AI. ”Det är en siffra jag vill att ni tar med er”, sade Bergström. ”Tråkigt, men inte förvånande”, sade också Bergström om det faktum att skillnaderna mellan unga killars och tjejers attityd till AI är stora, där tjejer har både lägre kännedom och mindre intresse och optimism.

Lucella Bergström och Lina Rådström fortsatte diskussionen tillsammans.

Ökad ojämlikhet en risk

Virginia Dignum, professor vid datavetenskapliga institutionen vid Umeå universitet gav en kort föreläsning om det sociala ansvaret kring AI och beskrev den geografiskt och sociodemografiskt snedvridna datainmatning som ligger till grund för dagens AI-verktyg.

Verktygen baseras, påminde hon, i de flesta fall på information från ett mycket litet antal institutioner i det globala norr. Därför är det särskilt viktigt med riktlinjer som ser till att utvecklingen och implementeringen sker på ett inkluderande sätt. Med referens till ett av användningsområdena beskrev hon utvecklingen av AI som en bil utan förare och menade att ansvarsfull reglering måste till. En sådan, fortsatte hon, behöver inte stå i vägen för innovation utan kan snarare bidra till den.

Viktigast av allt, avslutade hon, är att minnas att AI är en artefakt, skapad av människor för vissa behov. Det samhället behöver göra är att fråga sig vilka behov AI ska användas för.

Även Henrik Kugelberg, forskare vid London School of Economics, betonade vikten av en jämlik och rättvis implementering av AI-teknik. I dag, menade han, är vi dock på väg i motsatt riktning: ett litet antal företag har en enorm makt över AI-tekniken. Och eftersom det är stora pengar det rör sig om kommer företagen inte vilja släppa makten frivilligt: utvecklandet av chat GPT kostade runt 100 miljoner dollar, nästa generations GPT kommer sannolikt kosta närmare en miljard dollar.

I diskussionen om AI riskerar också spekulationer om framtida hot att flytta fokus från nutida reella problem:

– Risken med allt prat om stora, framtida, existentiella risker med AI är att vi missar vad som sker här och nu – vilken makt som redan i dag finns hos företagen som utvecklar AI, sade Kugelberg.

Anti-monopollagstiftning är ett viktigt verktyg för att reglera fåtalet teknikföretags stora makt, menade Kugelberg, och avslutade med att som Dignum lyfta den större samhällsfråga som ligger bakom utvecklingen: vem har rätt att bestämma vilka värden som ska styra hur systemen ska utformas?

Marcus Lundstedt, kommunikationschef vid Stockholm Resilience Centre, talade om riskerna med misinformation och AI i klimatkommunikation. ”Misinformation håller på att urholka vetenskapen och ser ut att bli ett av de största hoten mot vårt samhälle idag” sa Lundstedt med ett citat från mötet Nobel Prize Summit där han medverkat.

En av anledningarna till att felaktig information kan spridas så framgångsrikt är våra sociala medier som matar oss med den information vi vill ha. Detta utnyttjas av organisationer med egna agendor – som oljebolag som anlitar influencers, sade Lundstedt. Och när en allt bättre AI möter misinformation i klimatfrågan riskerar människors beteende att påverkas i hög grad. Med en mer tillgänglig, allt mer sofistikerad och allt mer övertygande AI ökar ”volymen” i felaktigheterna.

Även Lundstedt talade om misinformation, AI-genererad eller inte, som en säkerhetsrisk. Här står Sverige oförberett, menade han.

Lösningen på misinformation handlar om att bli bättre på att kommunicera – vilket betyder bli bättre på att förstå människors enskilda sammanhang, känslor och bevekelsegrunder.

AI:s goda sida

Anamaria Dutceac Segesten, docent vid Lunds universitet, inledde med en definition av AI som visade dess avgränsningar och begränsningar. AI, sade hon, är system som är bra på mycket specifika uppgifter, som är autonoma men inte självständiga. Hon vände sig mot tanken att AI-system skulle vara ”our new overlords” och ville ge en mer positiv och praktisk syn på deras användning.

AI-verktyg som är praktiskt användbara för kommunikatörer, fortsatte hon, är till exempel de som handlar om datorseende, naturlig språkbehandling och taligenkänning. Hon exemplifierade med uppgifter och tjänster inom den offentliga sektorn där AI kan bidra till förbättrad tillgänglighet, bättre informationskvalitet och förbättrad offentlig diskussion med hjälp av chatbottar, automatisk översättning och spårning av modifierat innehåll.

Hon menade dock att kontrollen över och ansvaret förknippat med AI och dess utveckling behöver öka.

Samtalet fortsatte i en paneldiskussion med Anamaria Dutceac Segesten, Marcus Lundstedt och Henrik Kugelberg, London School of Economics.

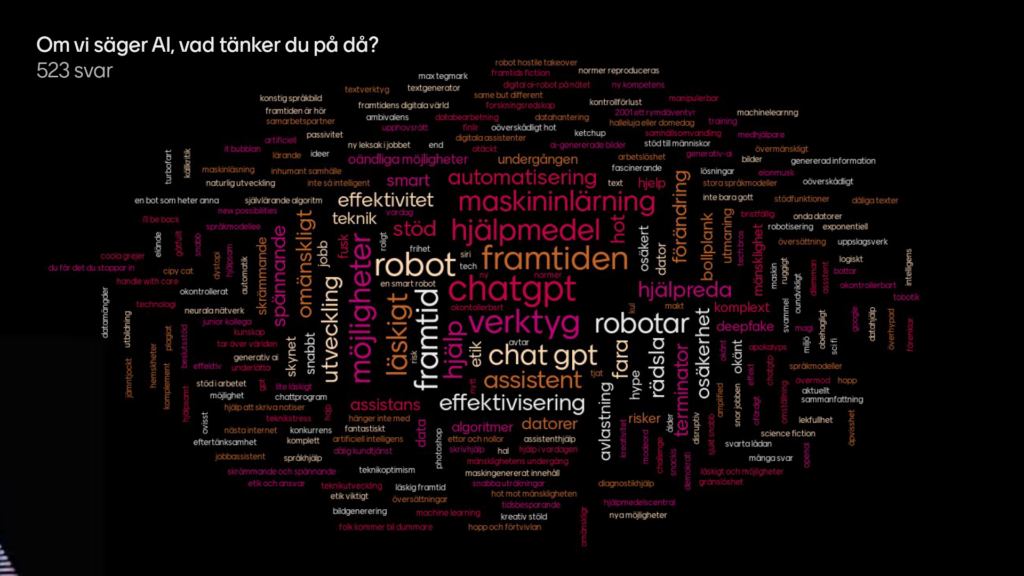

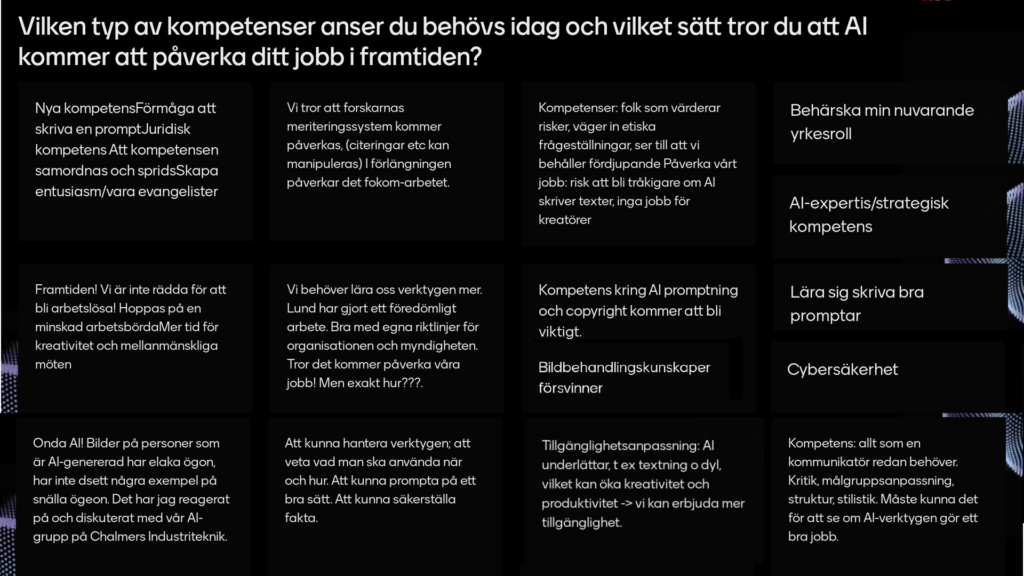

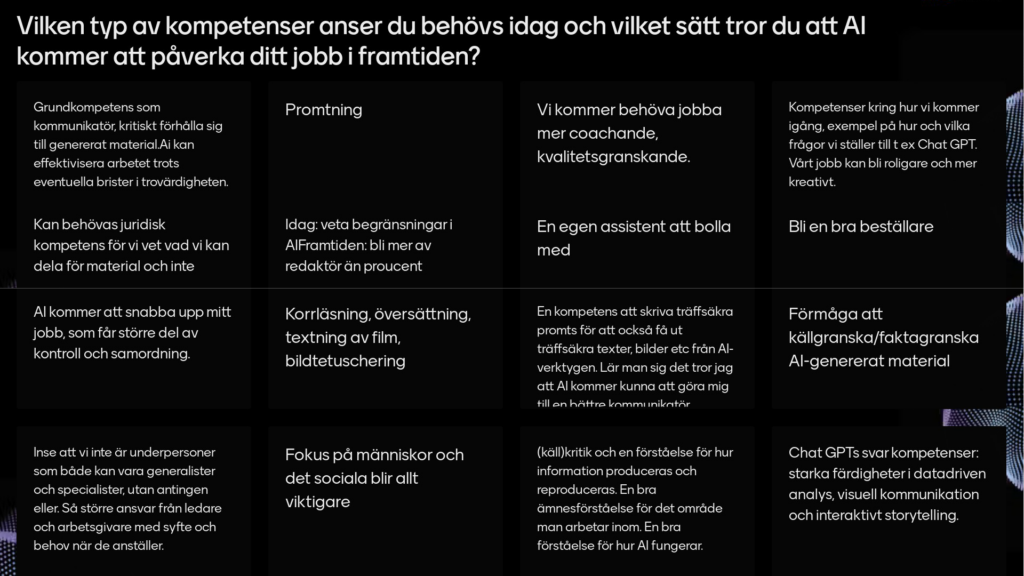

Om AI, kommunikatörsrollen, forskningskommunikation och du!

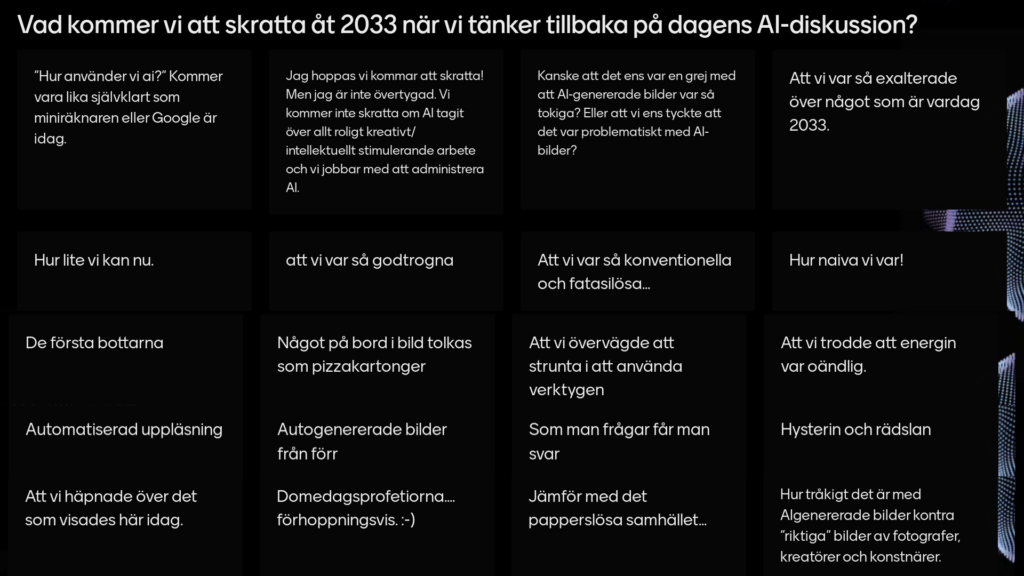

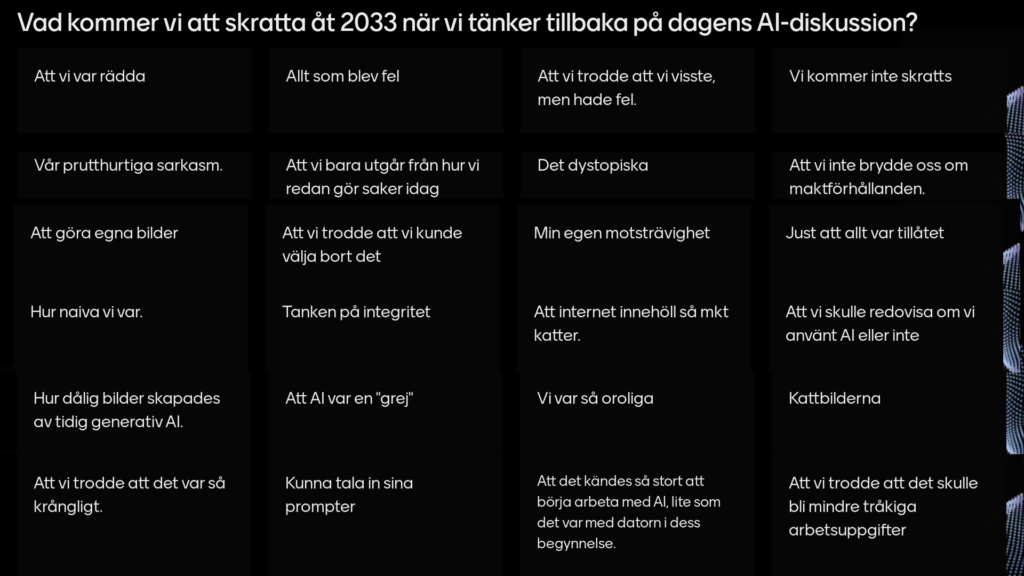

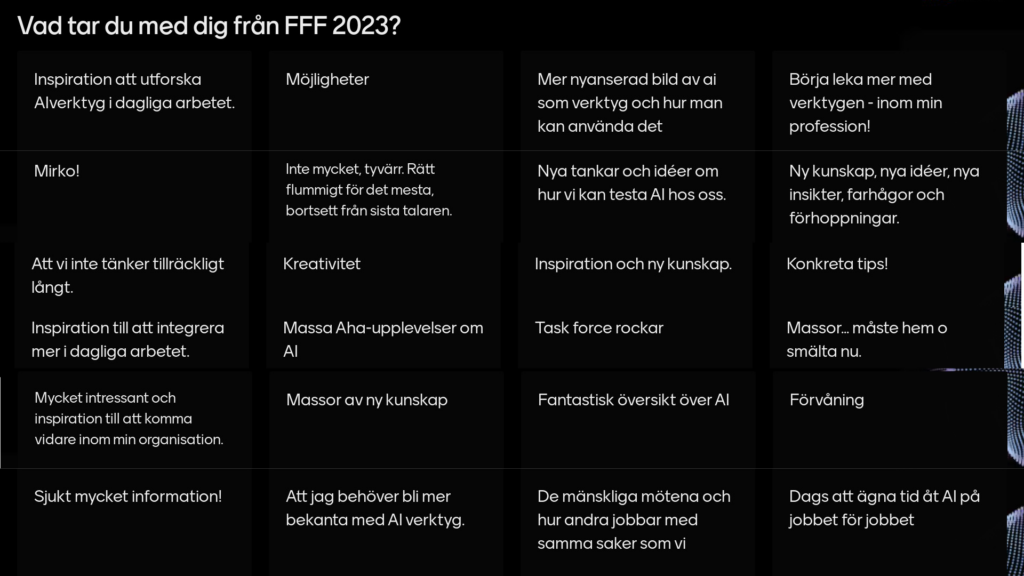

Hur AI påverkar arbetet på kommunikationsavdelningen samt vilka kompetenser som kommer att behövas diskuterades under eftermiddagens rundabordssamtal. Där deltagarna också fick möjlighet att dela med sig av sina egna erfarenheter.

Johanna Sandahl, kommunikationsdirektör på Lunds universitet, presenterade hur de jobbar med AI. De har bildat en “task force” med en handfull AI-intresserade medarbetare med uppdraget att nyfiket testa och utforska nya verktyg, utvärdera och sprida kunskapen internt.

“AI är här för att stanna, men en bra kommunikatör blir bättre med bra verktyg. Så ju bättre vi kan grunderna i kommunikatörsyrket, desto större användning får vi för AI-verktygen”, påpekade Johanna.

I det följande panelsamtalet med Johanna och Patrik Nilsson, chef för Politik och profession vid Akavia, berördes ett antal näraliggande frågor. Patrik betonade att det med AI-utvecklingen troligen inte är jobb som försvinner utan arbetsguppgifter – och att det i sig är positivt, men att yrkespersoner behöver fundera på vad man behöver kunna i framtiden när arbetslivet förändras.

Johanna instämde och påminde om att kommunikatörer ofta är väldigt bra på att bevaka omvärlden på uppdrag men också behöver bli bättre på att bevaka utvecklingen inom sitt eget område.

Årets pristagare Svart historia

Under dagen delades också Natur & Kulturs populärvetenskapliga pris ut. Årets pris gick till journalisten Amat Levin för hans arbete med det gränsöverskridande folkbildningsprojektet Svart historia. På plats för att dela ut priset var Jonas Olofsson, professor i psykologi vid Stockholms universitet samt representant för juryn.

– Det känns otroligt kul, det är ett arbete jag har gjort på egen hand. Jag är ju inte historiker, min roll som journalist är att fungera som en brygga mellan akademin och gemene man, sa Amat vid prisutdelningen.

En längre inspelad intervju med Amat Levin går att se här

Crash-course i AI

Ett uppskattat inslag under årets FFF var Mirko Bischofberger, hands-on workshop om olika AI-verktyg och hur man använder dem. Mirko gav deltagarna en demonstration av bildhanteringsverktyg, hur och vad man ska tänka på när man skriver prompter för ChatGPT samt hur andra AI-verktyg kan underlätta kommunikatörens arbete.

AI för samhällets bästa?

Lucella Bergström, Arnold Pears, lektor i lärande i STEM-ämnen vid KTH, och Anamaria Dutceac Segesten knöt ihop dagen i ett avslutande samtal om hur AI kan användas som ett inkluderande verktyg. Bland annat diskuterades om AI har en demokratiserande effekt och om det kan göra kunskap tillgänglig på ett enkelt sätt.

“Jag har en optimistisk syn. Alla har tillgång till gratis-versionen och det ger dig möjlighet att göra nya saker. Du behöver inga kunskaper för att rita, programmera etc – du kan göra mer än vad du kunde innan”, sade till exempel Anamaria Dutceac Segesten.

Arnold Pears reflekterade över hur lärosäten kan gynna studenter och ge dem rätt verktyg. Vi behöver fundera över från hur vi använder AI i utbildningssyfte och vi behöver utvärdera processer mer än specifika program, menade han.

Lucella Bergström hävdade att behovet av förändring och nya förhållningssätt var störst bland de vuxna och inte, som ofta antas, bland de unga. “Vårt arbetssätt förändrades under covid, inte de ungas – eleverna kan inte jobba hemifrån och individanpassa på samma sätt”, sade hon.

Avslutningsvis konstaterade Eva Schelin vd för KK-stiftelsen och Carina Dahlberg, kommunikationschef vid Knut och Alice Wallenbergsstiftelsen att kommunikatörens yrke fortsatt är mycket viktigt och att “en bra kommunikatör blir ännu bättre med bra verktyg”.